Obblighi trasparenza AI Act: cosa devono fare le PMI entro il 2 agosto 2026

Scadenza 2 agosto 2026 — non rinviata

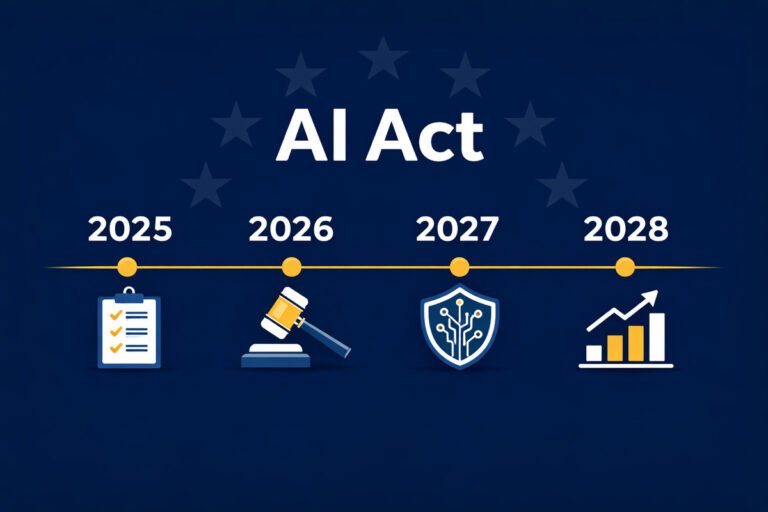

Gli obblighi di trasparenza dell’articolo 50 dell’AI Act (Regolamento UE 2024/1689) si applicano dal 2 agosto 2026. Il rinvio approvato dal Digital Omnibus riguarda solo i sistemi ad alto rischio (spostati al 2027-2028) e il watermarking dei contenuti sintetici (spostato al 2 dicembre 2026). Gli obblighi su chatbot, deepfake e dichiarazione natura AI restano al 2 agosto 2026. L’8 maggio 2026 la Commissione ha pubblicato le bozze di linee guida operative sull’art. 50, in consultazione fino al 3 giugno 2026.

Aggiornamento – 9 maggio 2026

L’accordo provvisorio tra Parlamento europeo e Consiglio UE del 7 maggio 2026 (Digital Omnibus) introduce una correzione importante su questo articolo: il watermarking dei contenuti generati da AI (art. 50 par. 2) viene posticipato al 2 dicembre 2026, non al 2 agosto 2026 come previsto in precedenza. Gli altri obblighi di trasparenza dell’art. 50 (chatbot, dichiarazione natura AI, deepfake) restano al 2 agosto 2026. L’accordo deve ancora essere formalmente adottato da PE e Consiglio, con l’obiettivo di chiudere entro il 2 agosto 2026.

L’8 maggio 2026 la Commissione UE ha pubblicato la bozza delle linee guida operative sull’art. 50 (draft guidelines on transparency obligations), aperta in consultazione fino al 3 giugno 2026. Il documento chiarisce ambito di applicazione, definizioni e obblighi concreti per provider e deployer. Disponibile su digital-strategy.ec.europa.eu. Fonti: comunicato Consiglio UE 7 maggio 2026.

Gli obblighi trasparenza AI Act entrano in vigore il 2 agosto 2026 e riguardano la maggior parte delle PMI italiane che usano strumenti di intelligenza artificiale. Se hai un chatbot sul sito, generi testi con ChatGPT, crei immagini con Midjourney o produci video con tool AI, l’articolo 50 del Regolamento UE 2024/1689 introduce regole precise su come informare i tuoi utenti. Non si tratta di obblighi riservati alle grandi aziende tech: ogni impresa che usa AI per interagire con le persone o per produrre contenuti e’ coinvolta.

La confusione nasce dal fatto che il Parlamento europeo ha votato il rinvio delle scadenze AI Act per i sistemi ad alto rischio al 2027-2028. Molte PMI hanno interpretato quel voto come un rinvio generale. Non lo è. Gli obblighi di trasparenza dell’art. 50 su chatbot, deepfake e dichiarazione natura AI restano al 2 agosto 2026. Solo il watermarking dei contenuti sintetici è stato spostato al 2 dicembre 2026 con l’accordo Digital Omnibus del 7 maggio 2026.

Cosa prevede l’articolo 50: gli obblighi trasparenza AI Act in concreto

L’articolo 50 dell’AI Act stabilisce quattro categorie di obblighi, distribuiti tra chi sviluppa i sistemi AI (fornitori) e chi li usa nella propria attivita’ (deployer, cioe’ utilizzatori — nell’AI Act, “qualsiasi persona fisica o giuridica che utilizza un sistema di IA sotto la propria autorita’”). Per la maggior parte delle PMI, il ruolo rilevante e’ quello di deployer.

1. Chatbot e sistemi che interagiscono con le persone

Qualsiasi sistema di IA destinato a interagire direttamente con persone fisiche deve informare l’utente che sta comunicando con un’intelligenza artificiale. L’obbligo non si applica quando l’interazione con un sistema AI e’ gia’ evidente dal contesto — ma attenzione: il criterio e’ quello di una “persona fisica ragionevolmente informata, attenta e avveduta”. Se c’e’ anche il minimo dubbio, meglio dichiarare.

In pratica: se hai un chatbot sul sito e-commerce, sull’assistenza clienti o sulla prenotazione appuntamenti, dal 2 agosto deve comparire un avviso chiaro — al primo contatto, non nascosto nel footer — che l’utente sta interagendo con un sistema AI.

2. Contenuti generati dall’AI: testi, immagini, audio, video

I fornitori di sistemi AI che generano contenuti sintetici devono garantire che gli output siano marcati in formato leggibile meccanicamente e rilevabili come generati o manipolati dall’AI. Questo vale per testi, immagini, audio e video. In pratica, OpenAI, Anthropic, Midjourney e gli altri provider devono implementare watermark e metadati nei contenuti generati.

Per le PMI come deployer, l’obbligo principale riguarda i deepfake e i testi di interesse pubblico. Se generi o manipoli immagini, audio o video che “assomigliano notevolmente a persone, oggetti, luoghi o eventi esistenti e potrebbero apparire falsamente autentici” (considerando 134 AI Act), devi rendere noto che il contenuto e’ stato generato artificialmente. Per i contenuti manifestamente artistici, creativi o satirici, l’obbligo si limita a rivelare l’esistenza della generazione artificiale senza ostacolare la fruizione dell’opera.

3. Testi generati con AI per informare il pubblico

Se pubblichi testi generati dall’AI “allo scopo di informare il pubblico su questioni di interesse pubblico”, devi dichiarare che il testo e’ stato generato o manipolato artificialmente. L’eccezione chiave: l’obbligo non si applica se il contenuto e’ stato sottoposto a revisione editoriale umana che ne garantisca l’affidabilita’ e che consenta di attribuire la responsabilita’ a una persona fisica o giuridica.

Per una PMI che usa ChatGPT per redigere blog post, newsletter o comunicati: se il testo viene rivisto, verificato e approvato da un essere umano prima della pubblicazione, l’obbligo di etichettatura non scatta. Ma se pubblichi output AI senza revisione su temi di interesse pubblico, devi dichiararlo.

4. Sistemi di riconoscimento delle emozioni e categorizzazione biometrica

Se usi sistemi AI di riconoscimento delle emozioni o categorizzazione biometrica (non rientranti tra quelli vietati dall’art. 5), devi informare le persone fisiche esposte al loro funzionamento e trattare i dati personali in conformita’ al GDPR. Per la maggior parte delle PMI italiane questo scenario non si applica, ma chi usa tool di analisi del sentiment basati su webcam o voce in contesti HR o customer service deve verificare.

Il Codice di buone pratiche sulla trasparenza: a che punto siamo

La Commissione europea sta elaborando un Codice di buone pratiche per facilitare l’attuazione degli obblighi di trasparenza dell’art. 50. La prima bozza, pubblicata a dicembre 2025, prevede un approccio su piu’ livelli: embedding di metadati con standard di provenance (incluso il C2PA), watermarking impercettibile integrato nei contenuti e sistemi di logging per i casi in cui le altre tecniche non siano sufficienti.

Per i deployer, la bozza prevede obblighi specifici di etichettatura: icone standardizzate per i contenuti AI-generated, un’icona fissa e visibile per i deepfake, avvertimenti sonori per contenuti audio generati dall’AI. La versione finale del Codice e’ attesa per maggio-giugno 2026, poco prima dell’entrata in vigore degli obblighi. Le linee guida della Commissione sui sistemi AI trasparenti sono previste nel secondo trimestre 2026.

Tre scenari concreti: obblighi trasparenza AI Act per PMI italiane

Ristorante con chatbot per prenotazioni

Un ristorante a Milano installa un chatbot AI sul sito per gestire le prenotazioni. Il chatbot risponde in linguaggio naturale, conferma disponibilita’ e invia promemoria. Dal 2 agosto 2026, all’inizio della conversazione deve comparire un avviso chiaro: “Stai comunicando con un assistente virtuale basato su intelligenza artificiale”. Non basta una nota nel footer o nelle condizioni d’uso. L’avviso deve essere visibile al primo contatto.

Agenzia di comunicazione che usa AI per i contenuti dei clienti

Un’agenzia genera immagini con Midjourney per i post social dei clienti e scrive bozze di articoli con ChatGPT. Per le immagini: se non sono manifestamente artistiche e potrebbero apparire come fotografie reali, l’agenzia deve etichettarle come generate dall’AI. Per i testi: se sono testi informativi su temi di interesse pubblico e vengono pubblicati senza revisione editoriale umana, serve la dichiarazione. Se invece un copywriter rivede, verifica e approva il contenuto, l’eccezione della revisione editoriale si applica. Per approfondire gli obblighi specifici delle agenzie, consulta la guida AI Act per agenzie di marketing.

E-commerce con descrizioni prodotto generate dall’AI

Un negozio online usa AI per generare le schede prodotto di 500 articoli. Le descrizioni sono commerciali, non informative su temi di interesse pubblico. In questo caso l’obbligo di etichettatura dei testi non scatta — le descrizioni prodotto non rientrano nella definizione di “testi pubblicati allo scopo di informare il pubblico su questioni di interesse pubblico”. Ma se lo stesso e-commerce usa un chatbot per l’assistenza clienti, il chatbot deve dichiararsi come AI. Se genera immagini di prodotti che sembrano fotografie reali, quelle immagini vanno marcate. Per il quadro completo sugli obblighi AI Act per gli e-commerce, vedi la guida dedicata.

Cosa NON e’ stato rinviato: la mappa degli obblighi trasparenza AI Act

Il voto del Parlamento europeo di marzo 2026 ha rinviato le scadenze per i sistemi ad alto rischio. Ma l’articolo 50 sulla trasparenza non e’ stato toccato. Ecco cosa e’ gia’ in vigore e cosa scatta il 2 agosto 2026:

Gia’ in vigore dal 2 febbraio 2025: l’obbligo di AI literacy (art. 4) — il personale che usa tool AI deve avere una formazione minima documentata. I divieti per le pratiche AI a rischio inaccettabile (art. 5).

In vigore dal 2 agosto 2025: gli obblighi per i fornitori di modelli AI di uso generale (GPAI), inclusa la documentazione tecnica e la marcatura degli output.

Dal 2 agosto 2026 (NON rinviato): gli obblighi di trasparenza dell’art. 50 per chatbot, deepfake e dichiarazione natura AI. Il regime sanzionatorio completo. Gli obblighi per i sistemi ad alto rischio dell’Allegato III – ma quest’ultimo punto è oggetto del rinvio approvato dal Digital Omnibus. Aggiornamento 7 maggio 2026: il watermarking dei contenuti sintetici (art. 50 par. 2) è posticipato al 2 dicembre 2026.

Rinviato al 2027-2028: gli obblighi specifici per i sistemi ad alto rischio (art. 6 par. 1 e disposizioni correlate). Ma attenzione: il rinvio e’ condizionato all’adozione degli standard tecnici del CEN-CENELEC e alla designazione delle autorita’ competenti negli Stati membri. Se il Digital Omnibus non viene approvato prima di agosto 2026, torna automaticamente in vigore la timeline originaria.

Checklist: come prepararsi agli obblighi trasparenza AI Act

- Fai l’inventario dei sistemi AI in uso. Elenca tutti gli strumenti AI usati in azienda: chatbot, generatori di testo, generatori di immagini, tool di automazione, assistenti vocali. Per ognuno, identifica se interagisce con persone fisiche e se genera contenuti. Se non l’hai ancora fatto, la mappatura degli strumenti AI e’ il punto di partenza.

- Classifica gli obblighi per ogni sistema. Per capire se il tuo software rientra nella definizione di sistema AI secondo l’AI Act, usa il test ufficiale della Commissione UE. Chatbot → obbligo di dichiarazione al primo contatto. Immagini/video AI → obbligo di marcatura. Testi informativi AI senza revisione → obbligo di dichiarazione. Testi commerciali con revisione → nessun obbligo specifico art. 50.

- Aggiorna chatbot e interfacce. Inserisci un messaggio di apertura che dichiari la natura AI del sistema. Deve essere visibile prima che l’utente inizi l’interazione, non dopo.

- Definisci il processo editoriale per i contenuti AI. Se usi AI per generare testi che vengono poi pubblicati, documenta il processo di revisione umana. Chi rivede? Come viene verificata l’accuratezza? C’e’ una persona responsabile del contenuto finale? Questa documentazione e’ la tua prova che l’eccezione della revisione editoriale si applica.

- Verifica i contratti con i fornitori AI. I tuoi provider devono garantire che gli output siano marcabili. Verifica che i contratti con i fornitori AI coprano gli obblighi di trasparenza e che i tool utilizzati supportino watermark e metadati.

- Forma il personale. L’obbligo di AI literacy e’ gia’ in vigore dal febbraio 2025. Assicurati che il team sappia quali contenuti richiedono etichettatura e quali no. Per i contenuti usati in ambito marketing, usa la guida GDPR e AI come riferimento sugli obblighi privacy collegati.

Le sanzioni: cosa rischia chi non rispetta l’art. 50

L’AI Act prevede sanzioni fino a 15 milioni di euro o al 3% del fatturato mondiale annuo per la violazione degli obblighi dell’articolo 50. Per le PMI e le startup, il regolamento prevede sanzioni proporzionate — ma “proporzionate” non significa irrilevanti. Il regime sanzionatorio completo si applica dal 2 agosto 2026.

In Italia, la Legge 132/2025 ha designato AgID e ACN (Agenzia per la Cybersicurezza Nazionale) come autorita’ di riferimento. I decreti attuativi che preciseranno le modalita’ di vigilanza e sanzione sono in corso di emanazione. Per il quadro completo della Legge AI Italia 2025, consulta la guida dedicata.

FAQ

Approfondisci

Fonti e riferimenti ufficiali

- Regolamento (UE) 2024/1689 (AI Act) — art. 50 (obblighi di trasparenza), art. 4 (AI literacy), art. 99 (sanzioni) — testo ufficiale: eur-lex.europa.eu

- Commissione Europea — pagina dedicata all’AI Act, scadenze e strumenti di supporto: digital-strategy.ec.europa.eu

- Legge 23 settembre 2025, n. 132 — quadro normativo nazionale italiano sull’AI, designazione AgID e ACN: gazzettaufficiale.it

- Parlamento europeo — voto del 26 marzo 2026 sul Digital Omnibus e rinvio scadenze AI Act: europarl.europa.eu

- Consiglio UE — accordo provvisorio PE-Consiglio del 7 maggio 2026 (Digital Omnibus): consilium.europa.eu

- Commissione UE — bozza linee guida art. 50 AI Act, 8 maggio 2026 (consultazione aperta fino al 3 giugno 2026): digital-strategy.ec.europa.eu

Questo articolo non costituisce consulenza legale.